国立研究開発法人 産業技術総合研究所【理事長 中鉢 良治】(以下「産総研」という)分析計測標準研究部門【研究部門長 野中 秀彦】ナノ分光計測研究グループ 永宗 靖 主任研究員は、多層の人工ニューラルネットワークを用いた深層学習による赤外線画像の可視光カラー化技術を開発した。これにより、これまでモノクロや近似的なカラーでしか表示できなかった赤外線暗視画像を、可視光下での色に非常に近いカラーで表示することができるようになった。

|

| 図1 |

近年の防犯意識の高まりにより、防犯カメラや監視カメラなどのセキュリティーカメラの需要がますます高まっている。しかしながら、夜間の撮影に用いられる従来の赤外線撮影技術による画像は、モノクロあるいは近似的なカラーであり、視認性の面で問題があった。モニター監視者の疲労軽減の観点などから、視認性の高い撮影技術が望まれている。

一方、深層学習を用いた機械学習は、コンピューターの計算能力の向上や計算技法などの基礎技術の発展により、近年、言語、画像、音声、機械制御、最適化技術など、さまざまな分野に応用されつつある。今回の開発に関連する画像変換に関しては、イラストやアニメの自動着色、モノクロ画像のカラー化への応用などがある。なお、可視光画像と赤外線画像では輝度情報が異なるため、輝度情報をそのまま用いる従来の可視光モノクロ画像のカラー化技術では、赤外線画像を可視光下でのカラーに変換できない。

産総研では、赤外線照明だけを用いて被写体のカラー動画を撮影できる赤外線カラー暗視撮影技術を開発してきた(2011年2月8日、2012年12月3日、2014年5月14日 産総研プレス発表)。物質の色は可視光領域における反射特性に依存するが、可視光領域の反射特性と赤外線領域の反射特性の間には相関関係があることが分かっており、これは、その相関関係に基づいて、赤外線画像から可視光下での被写体の色を再現する可視光カラー化技術である。しかし、その相関関係は弱く、完全に被写体の色を再現するまでには至っていない。そこで、深層学習を用い、赤外線画像をより完全に近い被写体の色で再現する可視光カラー化技術の開発に取り組んだ。

今回、画像の特徴量を抽出し学習することができるCNNと時系列情報間の関連性を学習することができるRNNという深層学習の手法を基本に、輝度情報と色情報を同時に学習するモデルを構築することで、赤外線静止画や赤外線動画を可視光カラー化する技術を開発した。

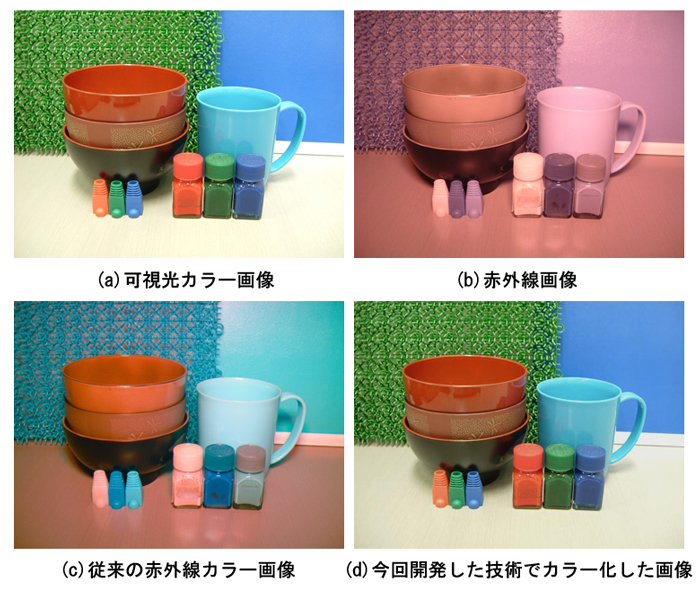

図1は、お椀やコップなどの被写体一式を赤外線カットフィルターのない通常のカメラで撮影した画像である。図1(a)は可視光下での通常のカラー画像、図1(b)は赤外線照射下での通常の赤外線画像、図1(c)は従来の技術で赤外線画像を可視光カラー化した画像(中心波長780 nm、 870 nm、 940 nm の画像をそれぞれ赤、青、緑に変換して合成した画像)、図1(d)は図1(b)の赤外線画像を今回開発した技術で可視光カラー化した画像である。図1(c)と図1(d)を比較すると、図1(d)では色再現性が大幅に改善され、図1(a)と区別できない程度まで再現されているのが分かる。

なお、ここではCNNを基本とするモデルを用いているが、入力画像を変化させて学習させることにより、過学習の抑制あるいは汎化性の向上が期待される。そのため、図1(b)とその鏡映、反転、回転画像を入力画像とし、図1(a)とその鏡映、反転、回転画像を教師画像としてそれぞれ学習し、学習済みモデルに図1(b)を入力して変換し図1(d)を得ている。この際の変換時間は約30 msであり、リアルタイムでの変換が可能である。

また、シリコンイメージセンサーを用いた通常のカメラでは、赤外線領域の850 nm程度まで、カラー化フィルターの各分光特性間に差があるため、図1(b)の赤外線画像が色付いて見えるが、モノクロ画像と比較して情報量が増えるため、その分光情報も利用して学習させた。産総研が開発した赤外線カラー暗視カメラのような赤外線領域に特殊な分光特性を持たせたカメラで撮影したより情報量の多い画像を用いると学習効率をさらに上げることができる。

|

| 図2 |

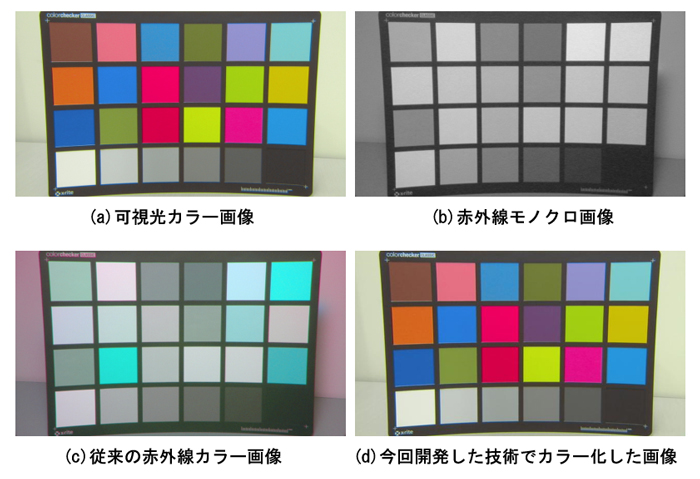

一方、カラー画像より情報量が少ないため、その分、学習に時間が掛かるが、赤外線モノクロ画像の可視光カラー化も可能である。図2はカラーチャートを撮影したものであり、図2(a)は可視光下での通常のカラー画像、図2(b)は赤外線照射下での通常の赤外線モノクロ画像(中心波長870 nm) 、図2(c)は従来の赤外線カラー画像(中心波長780 nm、 870 nm、940 nm)、図2(d)は図2(b)を、CNNモデルを用いて変換した赤外線カラー画像である。

|

| 図3 |

図2(c)に示すように、従来の赤外線カラー画像では、赤外線が透過しやすい紙や布などの薄い素材に対してはカラー化が困難であったが、図2(d)に示すように、可視光カラー画像を教師画像として学習する深層学習を用いれば、赤外線領域に分光情報のない赤外線モノクロ画像もカラー化でき、しかも、図2(c)と比べて色再現性が格段に改善しているのが分かる。

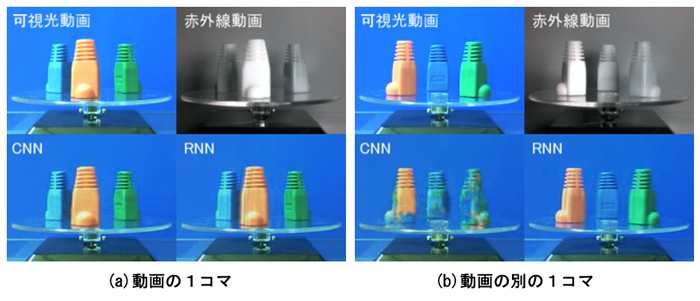

図3は、青色のプラスチックボードの前に置いたターンテーブル上に、赤、緑、青のイーサーネットコネクタキャップを乗せた被写体一式を、ターンテーブルの回転中に撮影・録画した動画の特徴的な2組のコマを示す。ここで、図3(a)、(b)のそれぞれの左上は可視光動画の1コマ、右上は赤外線動画の1コマ、左下は赤外線動画をCNNモデルにより変換した赤外線カラー動画の1コマ、右下は赤外線動画をRNNモデルにより変換した赤外線カラー動画の1コマである。

なお、ここでは38秒程の赤外線動画とそれに対応し教師動画とする可視光動画の各1153コマを用いてそれぞれCNNモデルまたはRNNモデルにより学習させ、それぞれの学習済みモデルに赤外線動画を入力してそれぞれの赤外線カラー動画を得ている。

RNNモデルは学習に時間が掛かるため、図3(a)ではRNNモデルによる画像に学習不足によると思われる粗さが残っているが、図3(b)ではCNNモデルよりRNNモデルによる画像の方が優れているように見える。画像の特徴量から色を推定するCNNモデルでは、類似した形状の物体がある場合、識別に混乱が生じる場合もあるが、時系列情報間の関連性を考慮するRNNモデルではそれが改善されていることを示していると考えられる。

本技術をさらに改善することで、視認性の高いセキュリティーカメラや夜行性動物の生態記録などへの応用が期待される。

今後は、深層学習のモデルの高度化やビッグデータを収集し学習させることで、汎化性の向上や画質の改善、より完全に近い色再現の実現を試みる。